Ollama本地部署与远程访问的全流程实战指南

cooldream2009

前言

在大模型应用逐步走向工程化落地的背景下,“本地部署”已从尝鲜阶段进入实际生产辅助阶段。相比云端API调用,本地部署具备数据私有化、调用低延迟、成本可控等显著优势,尤其适用于企业内部知识库、RAG系统以及离线AI应用场景。

Ollama 作为当前主流的本地大模型运行框架之一,通过对模型加载、推理服务、API接口的统一封装,大幅降低了使用门槛,使开发者能够以接近“服务化”的方式调用本地模型。

本文将在不仅覆盖安装与配置流程,还将深入讲解网络访问机制、系统层面原理以及常见问题的工程化排查方法,帮助你构建一个稳定、可扩展的本地大模型服务环境。

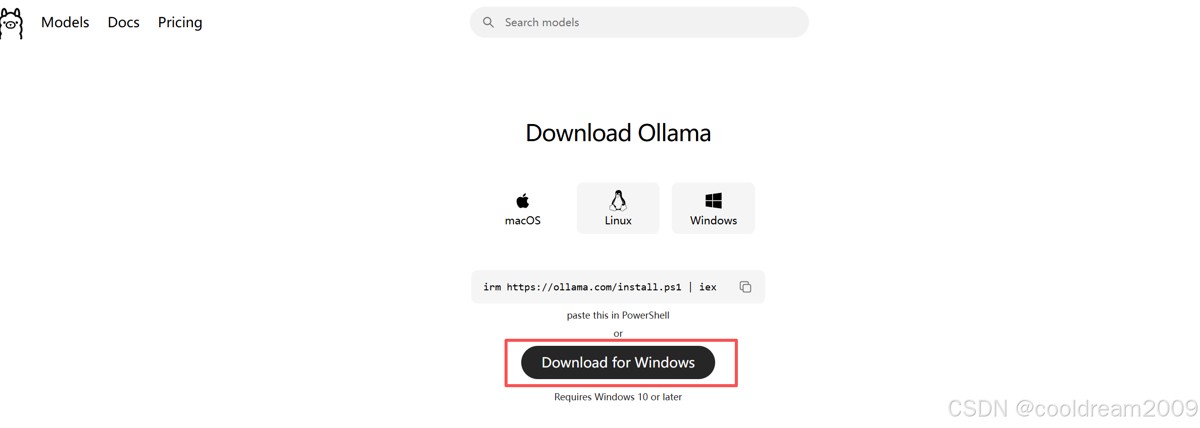

1 Ollama下载安装

1.1 下载

Ollama 官方提供 Windows 平台的安装支持,建议直接通过官网获取最新版本,以确保兼容性与安全性:

https://ollama.com/download/windows

下载页面通常会提供:

- 最新稳定版本(推荐)

- 更新日志(可查看版本差异)

- 多平台安装入口

建议开发环境尽量保持版本统一,避免因版本差异导致接口行为不一致。

1.2 安装

Ollama 在 Windows 上的安装流程高度简化,属于标准安装程序:

- 双击

.exe安装包 - 按提示完成安装流程

- 可自定义安装路径(建议选择非系统盘,如

D:\Ollama)

安装完成后,系统会自动完成以下操作:

- 注册 Ollama 后台服务

- 初始化默认配置

- 创建模型存储目录

- 开放本地API端口(默认11434)

2 Ollama基础配置

2.1 常规设置

Ollama 默认配置可以直接使用,但在实际开发中,建议根据硬件条件进行优化调整。

关键配置项如下:

| 配置项 | 说明 | 建议 |

|---|---|---|

| 模型存储路径 | 模型文件默认存放目录 | 使用SSD磁盘提升加载速度 |

| 自启动 | 是否随系统启动 | 开发环境可关闭,服务环境建议开启 |

| 资源占用 | CPU / 内存 / GPU使用情况 | 根据模型大小合理规划 |

在多模型场景中,建议定期清理未使用模型,避免磁盘占用过高。

2.2 网络设置(默认行为解析)

Ollama 默认监听地址为:

127.0.0.1:11434

该配置具有如下特性:

- 仅允许本机访问(Loopback接口)

- 无法被局域网设备访问

- WSL 默认无法直接访问

- 外网完全不可访问

这一设计本质上是出于安全考虑,防止未授权访问本地模型服务。

3 开启远程访问能力(核心配置)

3.1 修改监听地址(关键步骤)

要实现跨设备访问,必须将监听地址修改为:

0.0.0.0:11434

该地址表示监听所有网络接口(包括内网IP、虚拟网卡等)。

推荐方式:配置系统环境变量

操作流程:

- 按

Win + R - 输入

sysdm.cpl - 进入 高级 → 环境变量

- 在“系统变量”中新增变量:

| 变量名 | 变量值 |

|---|---|

| OLLAMA_HOST | 0.0.0.0:11434 |

保存后执行:

- 重启 Ollama

- 或直接重启系统(推荐)

3.2 防火墙放行端口(必要条件)

即使监听地址已修改,如果系统防火墙未开放端口,外部请求仍会被拦截。

PowerShell快速配置(推荐)

以管理员身份运行:

New-NetFirewallRule -DisplayName "Ollama Port 11434" -Direction Inbound -Protocol TCP -LocalPort 11434 -Action Allow

该命令将创建一条入站规则,允许所有来源访问11434端口。

3.3 图形界面检查

手动检查路径:

- 打开“Windows Defender 防火墙”

- 点击“高级设置”

- 查看入站规则

重点确认:

- 是否存在11434端口规则

- 是否被启用(Enabled)

- 是否允许连接(Allow)

4 服务验证与运行状态分析

4.1 端口监听验证

执行命令:

netstat -ano | findstr 11434

典型输出如下:

TCP 0.0.0.0:11434 LISTENING

4.2 状态判读方法

| 输出结果 | 说明 |

|---|---|

| 127.0.0.1 | 仅本地访问 |

| 0.0.0.0 | 已支持远程访问 |

| 无结果 | 服务未启动或异常 |

4.3 进程确认(进阶排查)

可结合PID进一步分析:

tasklist | findstr 33060

确认对应进程是否为 Ollama 服务。

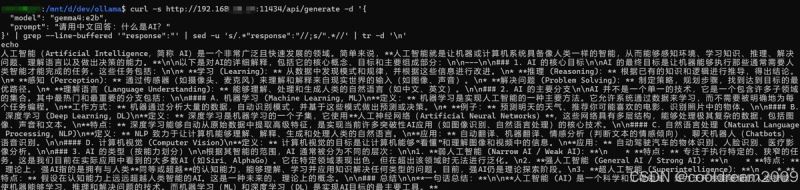

5 多环境访问(WSL / 局域网 / 前端调用)

在实际开发中,常见访问方式包括:

- WSL 调用本地模型

- 前端项目调用 API

- 局域网其他设备访问

统一访问方式如下:

http://主机IP:11434

例如:

curl -s http://192.168.18.11:11434/api/generate -d '{

"model": "gemma4:e2b",

"prompt": "请用中文回答:什么是AI?"

}' | grep --line-buffered '"response":"' | sed -u 's/.*"response":"//;s/".*//' | tr -d '\n'

echo

5.1 关键前提条件

必须满足:

- 已设置

OLLAMA_HOST=0.0.0.0:11434 - 防火墙端口已开放

- 使用正确的主机IP地址

5.2 常见错误总结

- 使用

localhost(仅本机有效) - 忘记重启服务

- IP地址错误(动态IP变化)

- 防火墙规则未生效

6 常见问题与系统化排查

为提高问题定位效率,建议按照“由外到内”的顺序排查:

- 网络是否通(ping 主机IP)

- 端口是否开放(telnet/ip测试)

- 服务是否监听(netstat)

- 配置是否生效(环境变量)

6.1 无法远程访问

重点检查:

- 是否仍监听127.0.0.1

- 防火墙是否拦截

- 是否使用公网/内网错误地址

6.2 WSL无法访问

本质原因:

- WSL与Windows网络隔离

- Loopback地址不共享

解决方案:

- 使用 Windows 主机IP访问

- 修改监听地址为0.0.0.0

6.3 端口冲突问题

检查端口占用:

netstat -ano | findstr 11434

如被占用:

- 修改端口

- 或关闭冲突进程

7 工程化最佳实践

在实际项目中,建议对 Ollama 服务进行进一步工程化处理:

使用 Nginx 反向代理

- 实现统一入口

- 支持HTTPS

增加访问控制(IP白名单)

与后端服务解耦(微服务架构)

结合 Docker 进行环境隔离

配合 RAG 构建知识问答系统

此外,对于生产环境,还需重点关注:

- 资源监控(CPU/GPU/内存)

- 并发控制

- 日志记录与追踪

结语

通过本文的系统梳理,你可以完整掌握 Ollama 从安装到远程访问的全流程核心要点:

- 默认仅支持本地访问

- 修改监听地址是实现远程访问的核心

- 防火墙配置是关键限制因素

- 使用 netstat 可快速定位问题

- 多环境访问需统一使用主机IP

在此基础上,你可以进一步将 Ollama 作为底层推理引擎,构建更复杂的AI系统,例如:

- 本地知识库问答(RAG)

- 智能Agent系统

- 企业级AI应用平台

本地大模型不再只是“能跑起来”,而是可以真正成为你系统架构中的一部分。

以上就是Ollama本地部署与远程访问全流程实战指南的详细内容,更多关于Ollama本地部署与远程访问的资料请关注脚本之家其它相关文章!