CentOS服务器离线部署DeepSeek用作AI本地知识库

作者:lj907722644

最近国产大模型 DeepSeek 非常火,但由于访问人数过多经常频繁出现反应迟缓甚至是宕机的情况。但万幸的是,DeepSeek 是一个开源模型,我们可以通过本地部署在自己的终端上随时使用,如果部署到本地后无需联网即可直接使用。

1. 安装Ollama

如果想要在本地运行 DeepSeek 需要用到 Ollama 这个工具,这是一个开源的本地大模型运行工具。

我们可以进入 Ollama 官网下载 Ollama ,Ollama官网:https://ollama.com/download/linux

使用官网提供的命令直接安装

curl -fsSL https://ollama.com/install.sh | sh

大概率下载不了安装包,使用下面步骤手动安装吧

下载安装包

curl -L https://ollama.com/download/ollama-linux-amd64.tgz -o ollama-linux-amd64.tgz

官网提供命令下载安装包,依然下载不了。

使用魔法上网,新开浏览器访问https://ollama.com/download/ollama-linux-amd64.tgz会自动下载。

将下载好的文件上传至服务器 /opt/ollama 目录

解压ollama到/usr目录下

sudo tar -C /usr -xzf ollama-linux-amd64.tgz

启动脚本

vim /etc/systemd/system/ollama.service [Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/usr/bin/ollama serve User=root Group=root Restart=always RestartSec=3 Environment="PATH=$PATH" # 解决ollama无法访问的问题 # 如果不配置这个,默认是127.0.0.1:11434,只能够本机连接,会导致docker部署的anythingllm连接不到ollama Environment="OLLAMA_HOST=0.0.0.0:11434" [Install] WantedBy=default.target

启动命令:

sudo systemctl daemon-reload sudo systemctl enable ollama.service sudo systemctl restart ollama.service sudo systemctl status ollama.service

查看状态:

# 查看ollama的版本 ollama -v # 查看已安装的大模型 ollama list

下载部署 Deepseek 模型

回到 https://ollama.com/ 网址中,在网页上方搜索框中输入 Deepseek-r1,这个 Deepseek-r1 就是我们需要本地部署的一个模型。点击 Deepseek-r1 后会进入详情界面,里面有多个参数规模可供选择,从 1.5b 到 671b 都有。

需注意的是,这里我们需要根据自己电脑的硬件配置来选择模型大小,大家可根据自己的电脑配置来自行选择,当然了,部署的本地模型越大,使用的深度求索效果就越好。

通过ollama安装大模型(根据硬件配置选择合适的)

本次安装DeepSeek R1 7b

ollama run deepseek-r1:7b

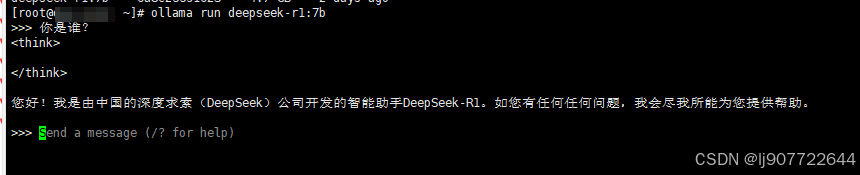

安装完成后可以测试问答

2. 使用docker安装AnythingLLM

备注:AnythingLLM、Dify、Open-WebUI对比

| AnythingLLM | Dify | Open-WebUI | |

|---|---|---|---|

| 主要目标 | 本地知识库 + 向量检索 + AI 问答 | 多场景对话管理 + 插件化扩展 | 纯聊天界面 + 多模型集成 |

| 对 Ollama 的集成方式 | 配置后端地址,将 Ollama 作为推理引擎 | 配置“模型”选项,调用 Ollama 的本地 API | 使用后台插件或统一接口连接 Ollama |

| 使用门槛 | 中等,需要了解向量检索原理及一些配置 | 较高,需要熟悉插件体系与多模型管理 | 较低,以网页 UI 为主进行模型选择和对话 |

| 文档/知识库支持 | 强:内置文档索引 + 检索 | 通过插件或自定义场景支持(需要额外配置) | 默认弱,仅提供单纯对话,需要自行扩展 |

| 插件/扩展性 | 具备一定的检索扩展和 API 接口,插件生态相对较少 | 强:本身就是一个可插拔平台,可快速对接多服务 | 较为活跃,很多社区贡献的小功能或自定义脚本 |

| 可视化界面 | 提供基本管理与问答界面 | 提供更丰富的对话流编排和配置界面 | 网页化聊天 UI,操作简便 |

| 应用场景 | 1. 企业文档问答 2. 个人知识管理 | 1. 多模型/多场景切换 2. 插件式客服/应用 | 1. 快速体验/切换本地模型 2. 个人聊天与测试 |

| 入门学习曲线 | 需要理解知识库+检索机制,但整体不算复杂 | 功能全面,但配置略复杂,适合有一定开发经验的团队 | 易上手,安装后打开网页即可使用 |

AnythingLLM 更专注于文档知识库与问答场景,自带向量检索管理,可“多文档整合”,接入 Ollama 后实现本地化问答。

Dify 功能多元,适合对话流管理、插件化扩展、团队协同等复杂需求。只要能在其后台正确配置 Ollama 地址,即可灵活调用。

Open-WebUI 走纯粹聊天界面路线,你可以把它当做一个能“轻松切换模型、马上对话”的 Web 面板,如果只是想单纯体验 Ollama 的生成效果,Open-WebUI 也许是最方便的。

访问地址:https://github.com/Mintplex-Labs/anything-llm/

下载镜像

docker pull mintplexlabs/anythingllm

建目录并赋权限

export STORAGE_LOCATION=/opt/anythingllm && \ mkdir -p $STORAGE_LOCATION && \ touch "$STORAGE_LOCATION/.env" chmod -R 777 /opt/anythingllm

运行容器

docker run -d -p 13001:3001 --restart=always \

--name anythingllm --add-host=host.docker.internal:host-gateway \

--cap-add SYS_ADMIN \

-v ${STORAGE_LOCATION}:/app/server/storage \

-v ${STORAGE_LOCATION}/.env:/app/server/.env \

-e STORAGE_DIR="/app/server/storage" \

mintplexlabs/anythingllm

web访问

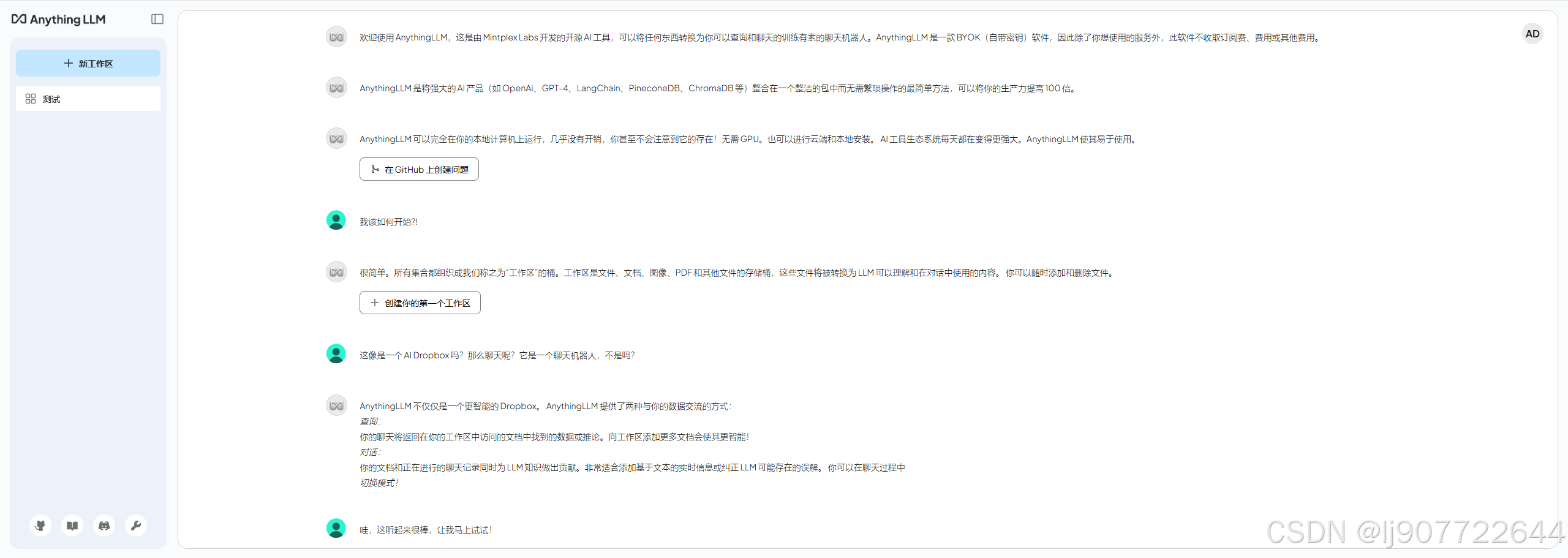

访问:http://服务器IP地址:13001

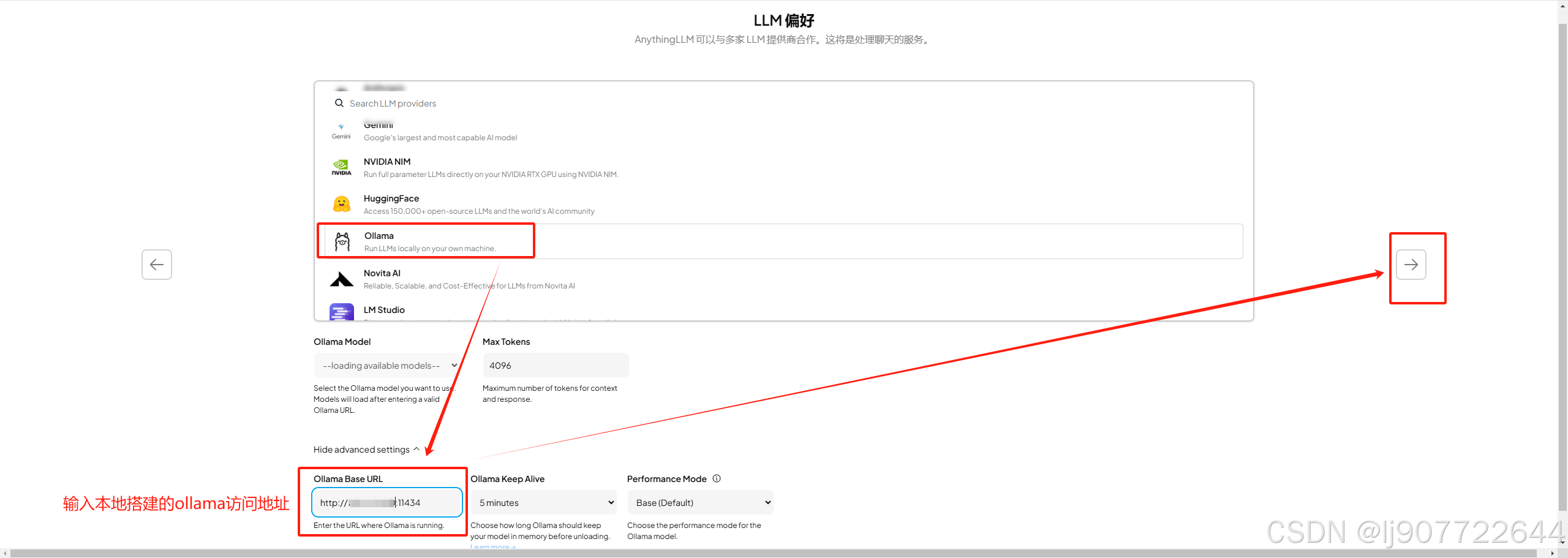

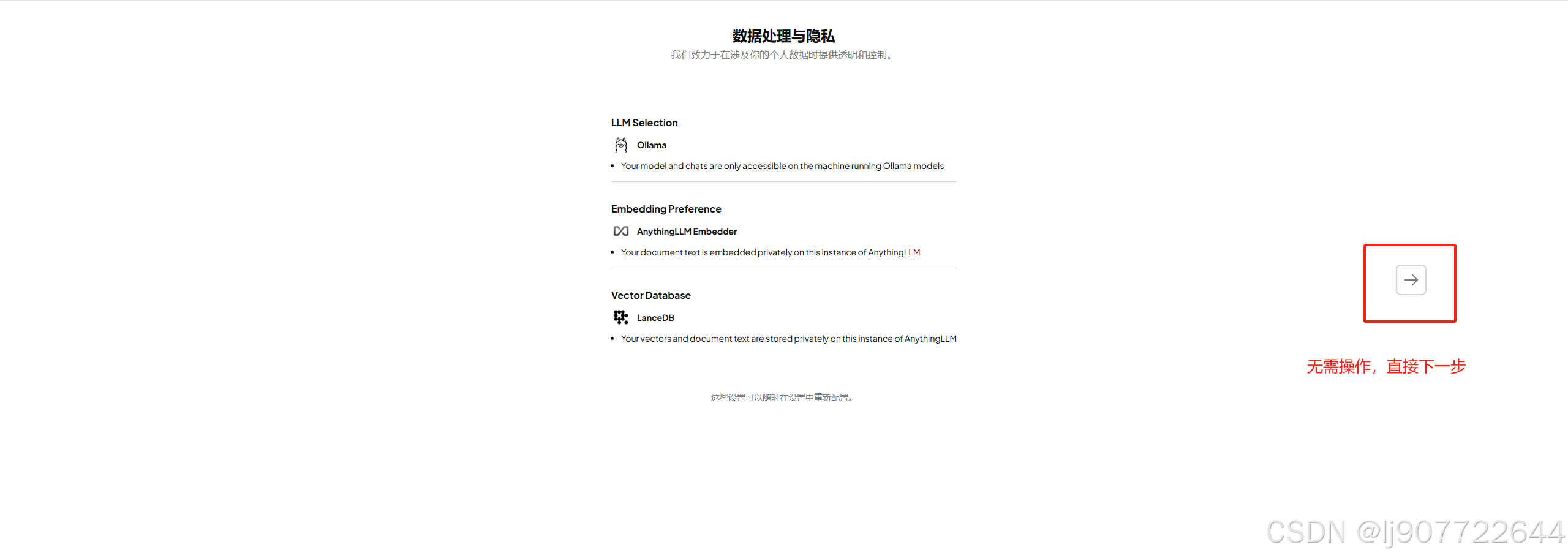

AnythingLLM配置

3. 建立知识库

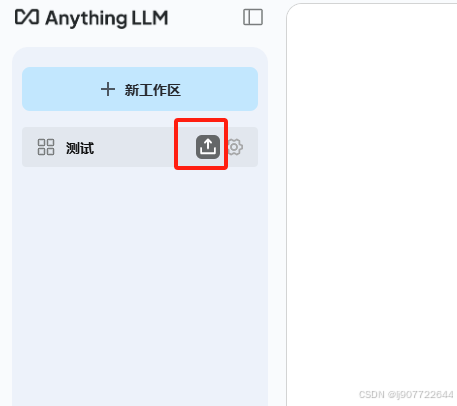

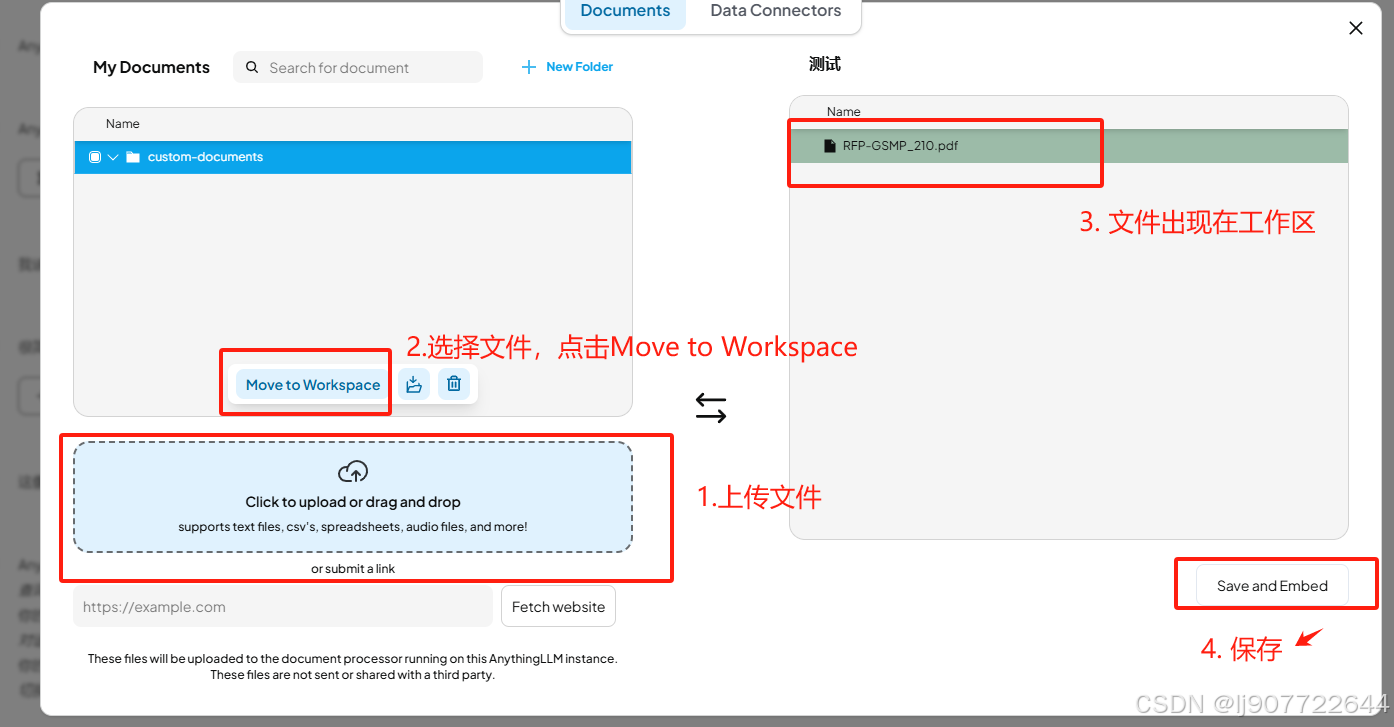

在AnythingLLM创建完工作区后,在工作区上传文档

Embed解释:

文档 Embed = 把文本变成向量 + 存入数据库 + 进行相似搜索。它是 AI 知识库、搜索推荐、智能问答的核心技术,让 AI 理解文本语义,而不只是匹配关键词。

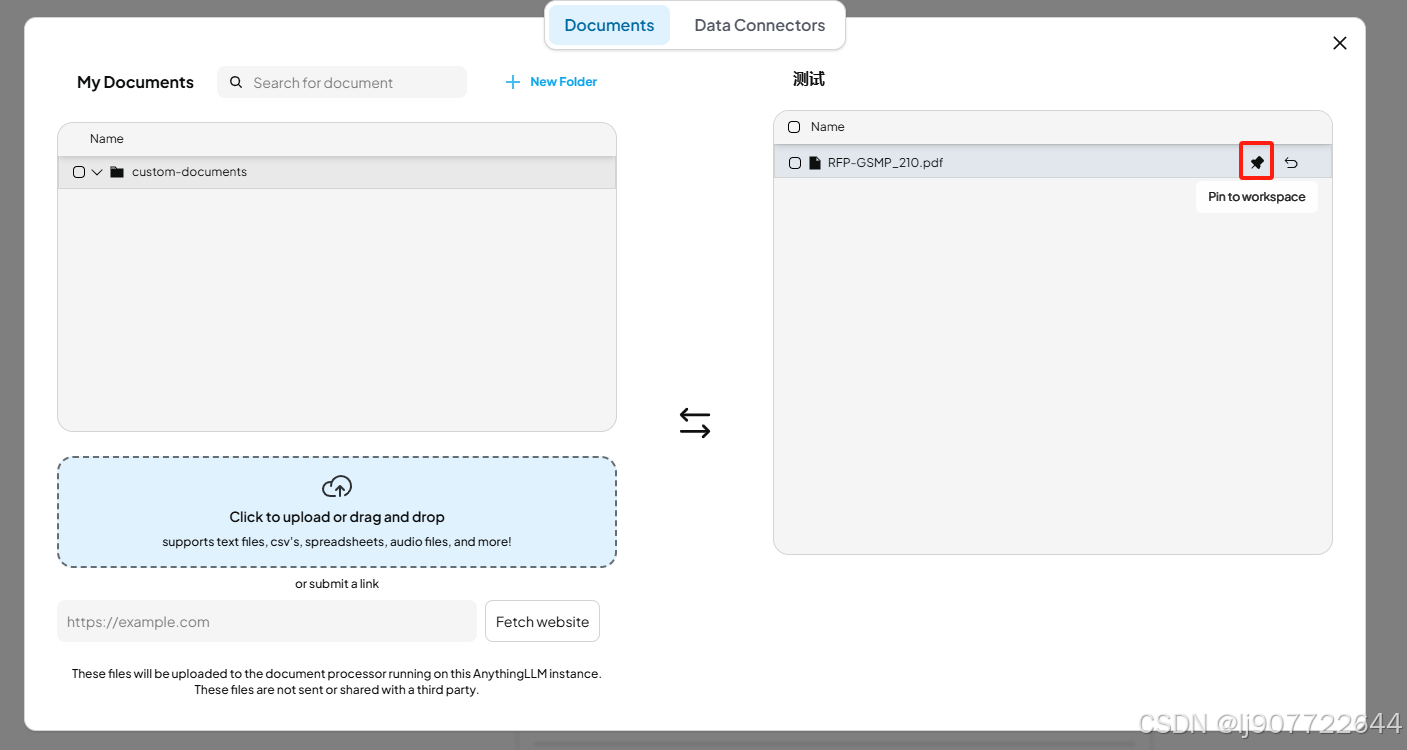

将文档关联到会话

文档上传到工作区后,点击文档后面的“图钉”按钮,可以关联文档到会话

进行问答测试

到此这篇关于CentOS服务器离线部署DeepSeek用作AI本地知识库的文章就介绍到这了,更多相关CentOS部署DeepSeek内容请搜索脚本之家以前的文章或继续浏览下面的相关文章希望大家以后多多支持脚本之家!