Java 中间件Kafka 分区策略(自定义分区器实现负载均衡)

作者:Jinkxs

在现代分布式系统架构中,Apache Kafka 作为高性能、高吞吐量的分布式消息中间件,已经成为构建实时数据管道和流式处理应用的核心组件。Kafka 的分区(Partition)机制是其能够实现水平扩展、并行处理以及高可用性的关键设计之一。而分区策略(Partitioning Strategy)——即决定每条消息应被写入哪个分区的逻辑——则直接影响着 Kafka 集群的负载均衡、吞吐性能和数据局部性。

本文将深入探讨 Kafka 的分区机制,重点讲解如何通过自定义分区器(Custom Partitioner)来实现更精细、更高效的负载均衡策略。我们将从基础概念出发,逐步过渡到实战编码,并结合实际场景分析不同策略的优劣。文章包含完整的 Java 代码示例、可运行的配置说明,以及使用 Mermaid 绘制的架构图,帮助你全面掌握这一核心技能。

1. Kafka 分区机制基础 🧱

1.1 什么是分区?

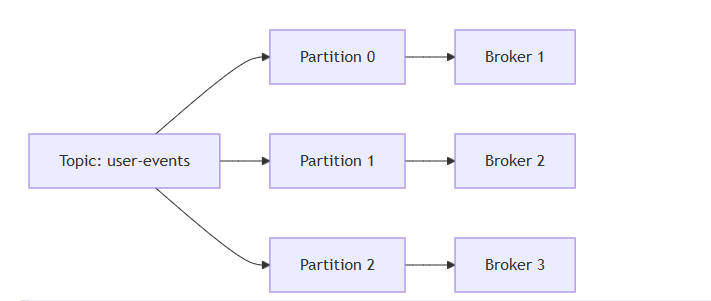

Kafka 的 Topic(主题)被划分为多个 Partition(分区)。每个分区是一个有序、不可变的消息序列,存储在 Kafka 集群的一个或多个 Broker 上。分区是 Kafka 并行处理的基本单位:

- 生产者可以同时向多个分区写入消息;

- 消费者可以组成 Consumer Group,每个分区只能被组内的一个消费者消费,从而实现并行消费;

- 分区支持副本机制(Replication),提高容错能力。

上图展示了

user-events主题被划分为 3 个分区,分别分布在不同的 Broker 上。

1.2 默认分区策略

Kafka 提供了默认的分区选择逻辑,由 DefaultPartitioner 实现。其规则如下:

- 如果指定了

partition字段(显式指定分区编号)→ 直接使用该分区; - 如果未指定分区但提供了

key→ 使用murmur2哈希算法对 key 进行哈希,然后对分区数取模,确保相同 key 的消息总是进入同一分区(保证顺序性); - 如果既无分区也无 key → 使用轮询(Round-Robin)策略,均匀分配到所有可用分区。

这种策略在大多数场景下表现良好,但在某些特定业务需求下可能不够灵活。例如:

- 某些 key 的消息量远大于其他 key,导致“热点分区”;

- 需要根据消息内容(如用户 ID、地区、设备类型)进行智能路由;

- 需要避开某些负载过高的分区以实现动态负载均衡。

此时,自定义分区器就成为必要手段。

2. 为什么需要自定义分区器?🎯

虽然默认分区器简单高效,但它无法满足所有业务场景。以下是一些典型需求场景:

场景一:避免热点分区 🔥

假设你的系统中有一个 VIP 用户(如 user_id=1001)产生了大量日志,而其他用户流量正常。使用默认分区器时,所有 user_id=1001 的消息都会进入同一个分区,导致该分区所在的 Broker 负载飙升,而其他分区闲置。

这种“数据倾斜”问题会严重限制系统的整体吞吐能力。

场景二:按业务维度分片 🗂️

你希望将来自不同地区的用户数据写入不同的分区,以便后续按地区进行独立处理(如区域化分析、合规存储等)。例如:

- 华北用户 → 分区 0

- 华东用户 → 分区 1

- 华南用户 → 分区 2

默认分区器无法实现这种语义化路由。

场景三:动态负载感知 📊

在集群运行过程中,某些 Broker 可能因硬件故障或网络问题导致负载升高。理想情况下,分区器应能感知这些状态,将新消息路由到负载较低的分区。

虽然 Kafka 本身不提供实时负载指标,但你可以结合外部监控系统(如 Prometheus + JMX)实现智能路由。

3. Kafka 分区器接口详解 🛠️

Kafka 允许用户通过实现 org.apache.kafka.clients.producer.Partitioner 接口来自定义分区逻辑。该接口定义如下:

public interface Partitioner extends Configurable, Closeable {

int partition(String topic, Object key, byte[] keyBytes,

Object value, byte[] valueBytes, Cluster cluster);

void close();

void configure(Map<String, ?> configs);

}核心方法说明:

partition(...):核心方法,返回消息应写入的分区索引(从 0 开始)。topic:目标主题名称;key/keyBytes:消息的 key(对象或字节数组);value/valueBytes:消息的 value;cluster:当前 Kafka 集群的元数据,包含所有 Topic、Partition、Broker 信息。

configure(...):初始化时调用,可用于读取配置参数;close():关闭资源,如线程池、连接等。

⚠️ 注意:

partition()方法必须是线程安全的,因为生产者内部会多线程调用它。

4. 实战:实现一个简单的自定义分区器 💻

我们先从一个最简单的例子开始:基于用户 ID 的哈希分区器,但增加对 VIP 用户的特殊处理。

4.1 项目依赖

确保你的 Maven 项目包含 Kafka 客户端依赖(以 Kafka 3.x 为例):

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka-clients</artifactId>

<version>3.6.0</version>

</dependency>4.2 自定义分区器代码

import org.apache.kafka.clients.producer.Partitioner;

import org.apache.kafka.common.Cluster;

import org.apache.kafka.common.PartitionInfo;

import java.util.List;

import java.util.Map;

import java.util.concurrent.ConcurrentHashMap;

public class UserIdPartitioner implements Partitioner {

// VIP 用户列表(可从配置或数据库加载)

private static final Set<String> VIP_USERS = Set.of("1001", "2005", "9999");

// 缓存 VIP 用户的专属分区,避免频繁计算

private final Map<String, Integer> vipPartitionCache = new ConcurrentHashMap<>();

@Override

public void configure(Map<String, ?> configs) {

// 可在此处读取自定义配置,如 VIP 列表、分区偏移量等

System.out.println("UserIdPartitioner configured.");

}

@Override

public int partition(String topic, Object key, byte[] keyBytes,

Object value, byte[] valueBytes, Cluster cluster) {

// 获取该 topic 的所有分区信息

List<PartitionInfo> partitions = cluster.partitionsForTopic(topic);

int numPartitions = partitions.size();

if (key == null) {

// 无 key 时,使用轮询(简化版)

return Math.abs(key.hashCode()) % numPartitions;

}

String userId = key.toString();

if (VIP_USERS.contains(userId)) {

// VIP 用户:固定分配到前 N 个分区(例如前 2 个)

// 为每个 VIP 用户分配唯一分区,避免冲突

return vipPartitionCache.computeIfAbsent(userId, k -> {

int index = VIP_USERS.stream().toList().indexOf(k);

return index % Math.min(2, numPartitions); // 最多使用 2 个分区

});

} else {

// 普通用户:使用标准哈希

return Math.abs(userId.hashCode()) % numPartitions;

}

}

@Override

public void close() {

vipPartitionCache.clear();

System.out.println("UserIdPartitioner closed.");

}

}4.3 配置生产者使用自定义分区器

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

// 关键配置:指定自定义分区器

props.put("partitioner.class", "com.example.UserIdPartitioner");

KafkaProducer<String, String> producer = new KafkaProducer<>(props);

// 发送消息

producer.send(new ProducerRecord<>("user-events", "1001", "VIP login"));

producer.send(new ProducerRecord<>("user-events", "5001", "Normal user action"));✅ 运行后,

user_id=1001的消息将始终进入分区 0 或 1(取决于 VIP 列表顺序),而普通用户按哈希分布。

5. 高级自定义分区器:实现动态负载均衡 ⚖️

前面的例子解决了热点问题,但仍是静态策略。现在我们尝试实现一个基于分区当前负载的动态分区器。

5.1 思路设计

由于 Kafka 客户端无法直接获取分区的实时负载(如消息速率、磁盘 IO),我们需要借助外部系统。一种可行方案是:

- 使用 JMX 指标(如

kafka.log:type=LogFlushStats,name=LogFlushRateAndTimeMs)监控各分区写入速率; - 通过 Prometheus + JMX Exporter 暴露指标;

- 在分区器中定期拉取这些指标,选择负载最低的分区。

📌 参考:Kafka Monitoring with Prometheus(官方指南)

5.2 简化版:基于分区消息计数的模拟负载

为便于演示,我们假设“负载”等于该分区已接收的消息数量(实际中不可行,仅用于示例)。

public class LoadAwarePartitioner implements Partitioner {

private final Map<Integer, Long> partitionLoad = new ConcurrentHashMap<>();

private final Random random = new Random();

@Override

public void configure(Map<String, ?> configs) {}

@Override

public int partition(String topic, Object key, byte[] keyBytes,

Object value, byte[] valueBytes, Cluster cluster) {

List<PartitionInfo> partitions = cluster.partitionsForTopic(topic);

int numPartitions = partitions.size();

if (key == null) {

// 无 key:选择负载最低的分区

return findLeastLoadedPartition(numPartitions);

}

// 有 key:仍需保证相同 key 进同一分区(顺序性)

// 但我们可以记录该分区的负载

int targetPartition = Math.abs(key.hashCode()) % numPartitions;

updateLoad(targetPartition);

return targetPartition;

}

private int findLeastLoadedPartition(int numPartitions) {

long minLoad = Long.MAX_VALUE;

int bestPartition = 0;

for (int i = 0; i < numPartitions; i++) {

long load = partitionLoad.getOrDefault(i, 0L);

if (load < minLoad) {

minLoad = load;

bestPartition = i;

}

}

// 更新负载(模拟)

updateLoad(bestPartition);

return bestPartition;

}

private void updateLoad(int partition) {

partitionLoad.compute(partition, (k, v) -> (v == null) ? 1L : v + 1);

}

@Override

public void close() {

partitionLoad.clear();

}

}⚠️ 注意:此实现仅用于教学!真实系统中,

partitionLoad应从外部监控系统获取,且需考虑线程安全、缓存过期等问题。

6. 分区策略与消息顺序性的权衡 ⚖️

在设计自定义分区器时,必须明确一个核心原则:

Kafka 仅保证单个分区内的消息顺序性,不保证跨分区的全局顺序。

因此,如果你的业务要求“同一用户的所有操作必须严格按序处理”,那么所有该用户的消息必须进入同一分区。此时,分区器必须基于用户 ID(或其他唯一标识)进行确定性路由。

错误示例:破坏顺序性

// ❌ 错误!相同 key 可能进入不同分区

public int partition(...) {

if (isVip(key)) {

return random.nextInt(numPartitions); // 随机分配 VIP

}

return hash(key) % numPartitions;

}上述代码会导致 VIP 用户的消息乱序,可能引发状态不一致问题(如“先扣款后下单”变成“先下单后扣款”)。

正确做法:保留 key 的确定性

// ✅ 正确:相同 key 始终进入同一分区

public int partition(...) {

if (isVip(key)) {

// 所有 VIP 用户进入分区 0

return 0;

}

return hash(key) % numPartitions;

}即使 VIP 用户集中在一个分区,也保证了其内部顺序。

7. 性能考量与最佳实践 🚦

自定义分区器虽强大,但也需注意性能影响:

7.1 避免复杂计算

partition() 方法在每次发送消息时都会被调用,因此必须高效。避免:

- 数据库查询;

- 网络请求;

- 复杂正则匹配;

- 未缓存的反射调用。

✅ 建议:

- 预加载配置到内存;

- 使用缓存(如

ConcurrentHashMap); - 优先使用

keyBytes而非反序列化key。

7.2 线程安全

分区器实例会被多个生产者线程共享,所有状态变量必须线程安全。

// ✅ 使用 ConcurrentHashMap private final Map<String, Integer> cache = new ConcurrentHashMap<>(); // ❌ 非线程安全 private Map<String, Integer> cache = new HashMap<>();

7.3 分区数量变化的处理

当 Topic 的分区数增加时,原有 key 的分区映射可能改变,导致:

- 消息不再进入原分区;

- 消费者可能重复消费或丢失消息。

📌 Kafka 官方建议:分区数一旦设定,尽量不要减少。增加分区需谨慎评估。

7.4 测试你的分区器

编写单元测试验证分区逻辑:

@Test

public void testVipUserRouting() {

UserIdPartitioner partitioner = new UserIdPartitioner();

partitioner.configure(Collections.emptyMap());

Cluster cluster = mockClusterWithPartitions(4); // 模拟 4 分区集群

int p1 = partitioner.partition("test", "1001", null, null, null, cluster);

int p2 = partitioner.partition("test", "1001", null, null, null, cluster);

assertEquals(p1, p2); // 同一 VIP 应进入同一分区

assertTrue(p1 < 2); // 且应在前 2 个分区

}8. 实际案例:电商订单系统的分区策略 🛒

假设你正在构建一个电商系统,订单消息包含:

{

"order_id": "O12345",

"user_id": "U789",

"region": "CN-EAST",

"amount": 299.99

}业务需求:

- 同一用户的订单必须按序处理(防止超卖);

- 华东地区订单量大,需更多分区处理;

- 避免单个分区成为瓶颈。

解决方案:

- Key 设计:使用

user_id作为消息 key; - 自定义分区器:根据

region和user_id联合路由。

public class RegionAwareOrderPartitioner implements Partitioner {

private static final Map<String, Integer> REGION_PARTITION_OFFSET = Map.of(

"CN-EAST", 0,

"CN-NORTH", 2,

"CN-SOUTH", 4

);

private static final int PARTITIONS_PER_REGION = 2;

@Override

public int partition(String topic, Object key, byte[] keyBytes,

Object value, byte[] valueBytes, Cluster cluster) {

// 假设 value 是 JSON 字符串

String jsonValue = (String) value;

String region = extractRegionFromJson(jsonValue); // 解析 region

int basePartition = REGION_PARTITION_OFFSET.getOrDefault(region, 0);

int totalPartitions = cluster.partitionsForTopic(topic).size();

// 计算该 region 的可用分区范围

int start = basePartition;

int end = Math.min(basePartition + PARTITIONS_PER_REGION, totalPartitions);

if (start >= totalPartitions) {

// fallback to default

return Math.abs(key.hashCode()) % totalPartitions;

}

// 在 region 内部按 user_id 哈希

int userHash = Math.abs(key.hashCode());

int regionPartition = start + (userHash % (end - start));

return regionPartition;

}

private String extractRegionFromJson(String json) {

// 简化:实际应使用 JSON 解析库

int start = json.indexOf("\"region\":\"") + 11;

int end = json.indexOf("\"", start);

return json.substring(start, end);

}

@Override

public void configure(Map<String, ?> configs) {}

@Override

public void close() {}

}分区布局示意:

渲染错误: Mermaid 渲染失败: Parsing failed: unexpected character: ->“<- at offset: 29, skipped 6 characters. unexpected character: ->:<- at offset: 36, skipped 1 characters. unexpected character: ->“<- at offset: 44, skipped 6 characters. unexpected character: ->:<- at offset: 51, skipped 1 characters. unexpected character: ->“<- at offset: 59, skipped 6 characters. unexpected character: ->:<- at offset: 66, skipped 1 characters. Expecting token of type 'EOF' but found `2`. Expecting token of type 'EOF' but found `2`. Expecting token of type 'EOF' but found `2`.

通过这种方式,华东的高流量被隔离在分区 0-1,不会影响其他区域;同时同一用户的消息仍在同一分区内,保证顺序。

9. 常见陷阱与调试技巧 🕵️♂️

9.1 分区器未生效?

检查以下几点:

partitioner.class配置是否正确(全限定类名);- 类是否在 classpath 中;

- 是否不小心指定了

ProducerRecord的partition参数(会覆盖分区器)。

9.2 消息分布不均?

使用 Kafka 自带工具查看分区偏移量:

kafka-run-class.sh kafka.tools.GetOffsetShell \ --broker-list localhost:9092 \ --topic user-events

输出示例:

user-events:0:15000 user-events:1:5000 user-events:2:5000

分区 0 明显偏高,可能存在热点 key。

9.3 如何监控分区器性能?

- 在

partition()方法中添加微基准测试(如System.nanoTime()); - 使用 APM 工具(如 SkyWalking、Pinpoint)追踪生产者调用链;

- 日志记录关键决策(如“VIP user routed to partition 0”)。

10. 扩展阅读与资源 📚

- Apache Kafka 官方文档 - Partitioning

- 官方对分区器的详细说明,包括配置参数和行为定义。

- Kafka: The Definitive Guide

- 由 Confluent 团队编写的权威指南,第 3 章深入讲解分区与复制机制。

- Understanding Kafka Partitioning

- Baeldung 的高质量教程,包含代码示例和图解。

结语 🌟

Kafka 的分区策略是连接业务逻辑与底层基础设施的关键桥梁。通过自定义分区器,我们不仅能解决默认策略的局限性,还能实现精细化的流量调度、热点隔离和区域化处理。然而,强大的能力也伴随着责任——必须谨慎权衡顺序性、负载均衡与系统复杂度。

在实际项目中,建议:

- 先用默认分区器,仅在出现性能瓶颈或业务需求时才自定义;

- 充分测试分区逻辑,尤其是边界条件和并发场景;

- 监控分区分布,及时发现数据倾斜;

- 保持简单,避免过度工程化。

希望本文能为你在 Kafka 分区策略的设计与实现上提供清晰的思路和实用的代码参考。Happy coding! 🎉

到此这篇关于Java 中间件Kafka 分区策略(自定义分区器实现负载均衡)的文章就介绍到这了,更多相关Java Kafka 分区策略内容请搜索脚本之家以前的文章或继续浏览下面的相关文章希望大家以后多多支持脚本之家!